要点速览

- 2026 年 AI 领域重大突破:自主智能体实现“自我验证(Self-Verification)”闭环

- 解决了困扰行业多年的“长链推理误差累积”问题

- Agent 现在能够在每一步操作后进行反思,并对比预期结果与实际反馈

- 该技术将 AI 智能体执行复杂任务的成功率从不足 50% 提升至 95% 以上

- 这为 AI 进入医疗手术辅助、精密财务审计等“零容忍”行业铺平了道路

新闻摘要

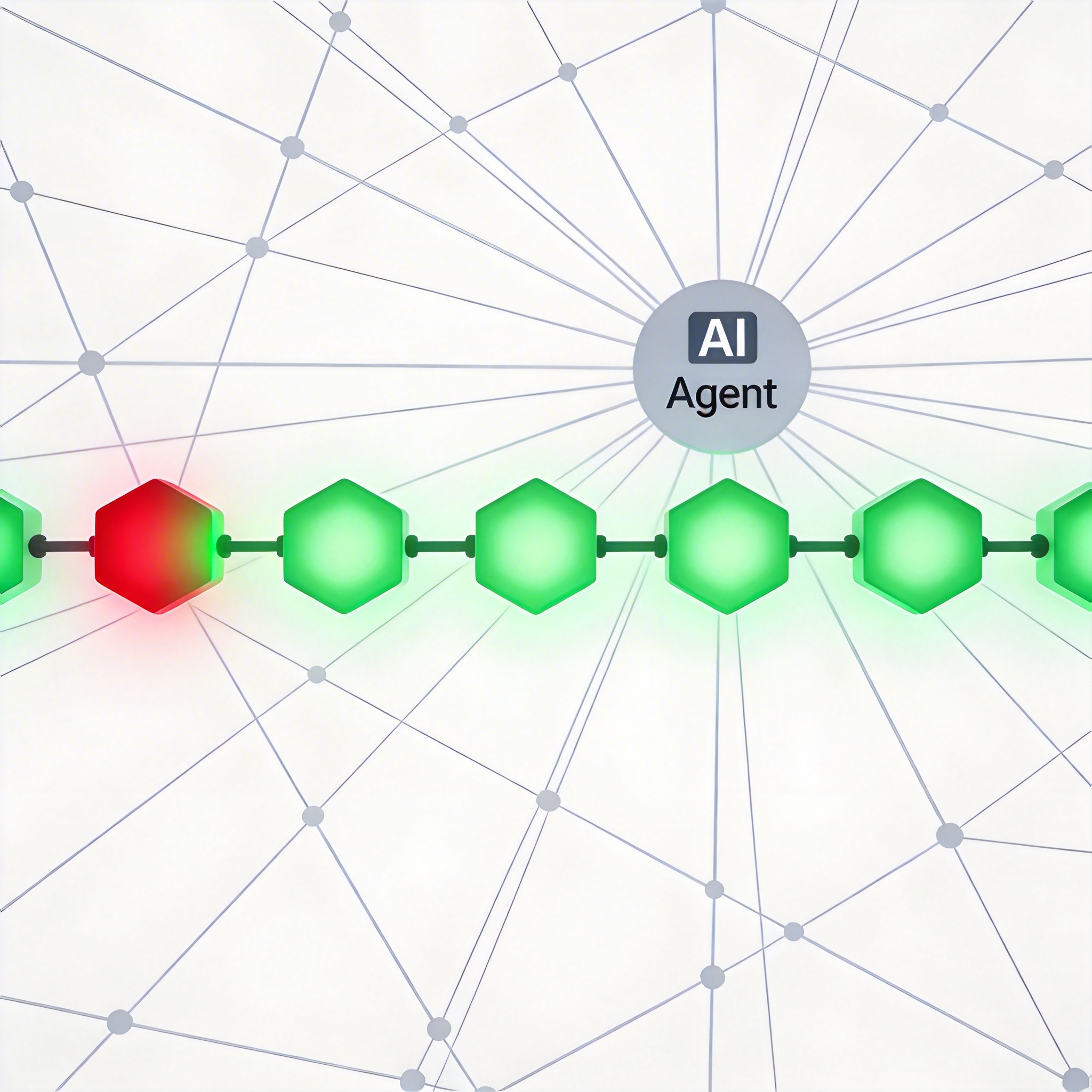

在 2026 年初的 AI 进化史中,“自我验证(Self-Verification)”被公认为最具里程碑意义的技术跃迁。在此之前,AI 智能体在执行多步骤任务时,往往会因为中间环节的一个微小偏差,导致最终结果南辕北辙。而现在,通过引入类似人类“回头看”的元认知机制,新一代 Agent 具备了在执行过程中实时发现并修正错误的能力。

InfoWorld 的分析报告指出,这种突破的核心在于“过程导向型评估(Process-oriented Evaluation)”。Agent 不再只是盲目追求输出,而是在每一个关键决策节点都会启动一个微型验证程序。例如,一个负责财务自动化的 Agent 在填写报表前,会自动对比多个数据源的逻辑一致性。如果发现冲突,它不会强行继续,而是主动寻找第三方证据或提示人类介入。这种“谨慎感”和“纠错欲”,让 AI 真正具备了替代人类处理严肃业务的潜力。

作者观点与解读

为什么这条新闻很重要?

可靠性是 AI 从“玩具”变成“工具”的唯一门槛。自我验证技术的成熟,意味着我们终于可以放心地把复杂任务交给 AI 去跑。

深度解读:

1. 对抗幻觉的终极武器:幻觉产生的原因往往是模型“停不下来”。自我验证强制模型在每一步都必须提供证据链,这极大地压缩了幻觉的生存空间。

2. 降低人类监督成本:以前我们需要“人在回路中(Human-in-the-loop)”来时刻盯着 AI。现在 Agent 可以自己审校自己的初稿,只有在无法自愈时才寻求人类帮助,这让一人管理上百个 Agent 成为可能。

3. 解锁“高价值”场景:保险理赔、法律分析、工程设计……这些过去 AI 只能做参考的领域,将迎来真正的自动化浪潮。

预测:

2026 年我们将看到第一批完全由 AI 独立完成的审计报告获得行业合规认证。到那时,AI 的竞争力将不仅仅是谁更聪明,而是谁更“靠谱”。